A nova atualização do ChatGPT finalmente quebra a barreira do texto | ENBLE

Nova atualização do ChatGPT quebra barreira do texto | ENBLE

O OpenAI está lançando novas funcionalidades para o ChatGPT que permitirão a execução de prompts com imagens e instruções de voz, além do texto.

A marca de IA anunciou na segunda-feira que estará disponibilizando esses novos recursos nas próximas duas semanas para usuários do ChatGPT Plus e Enterprise. O recurso de voz está disponível no iOS e Android, com possibilidade de adesão voluntária, enquanto o recurso de imagens está disponível em todas as plataformas do ChatGPT. A OpenAI planeja expandir a disponibilidade dos recursos de imagens e voz para além dos usuários pagos após a implantação escalonada.

O chat de voz funciona como uma conversa auditiva entre o usuário e o ChatGPT. Você pressiona o botão e faz sua pergunta. Após processar a informação, o chatbot lhe fornece uma resposta em forma de discurso auditivo, em vez de texto. O processo é semelhante ao uso de assistentes virtuais como Alexa ou Google Assistant e pode ser o prelúdio para uma reformulação completa dos assistentes virtuais como um todo. O anúncio da OpenAI vem poucos dias após a Amazon revelar um recurso semelhante que será implementado no Alexa.

Para implementar a comunicação de voz e áudio com o ChatGPT, a OpenAI utiliza um novo modelo de texto para fala capaz de gerar “áudio semelhante ao humano a partir de apenas texto e alguns segundos de amostra de fala”. Além disso, seu modelo Whisper pode “transcrever suas palavras faladas em texto”.

A OpenAI reconhece as questões que podem surgir devido ao poder por trás desse recurso, incluindo “o potencial de atores maliciosos se passarem por figuras públicas ou cometerem fraudes”.

- Fim das GPUs? Veja como poderia ser o DLSS 10 da Nvidia | ENBLE

- O Fedora 39 beta oferece a distribuição Linux com melhor desempenho...

- O investimento da Amazon nas habilidades de IA da Anthropic pode ch...

Essa é uma das principais razões pelas quais a empresa pretende limitar o uso de seus novos recursos a “casos de uso específicos e parcerias”. Mesmo quando os recursos estiverem mais amplamente disponíveis, eles serão acessíveis principalmente para usuários mais privilegiados, como desenvolvedores.

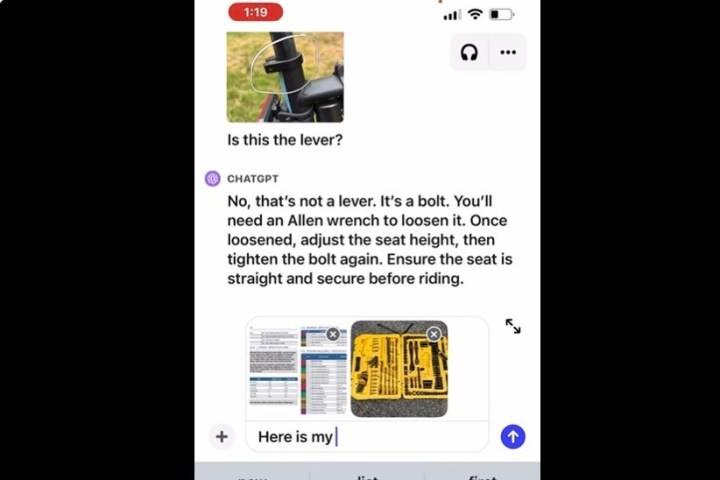

O recurso de imagem permite capturar uma imagem e inseri-la no ChatGPT com sua pergunta ou prompt. Você pode usar a ferramenta de desenho do aplicativo para ajudar a esclarecer sua resposta e ter uma conversa de ida e volta com o chatbot até resolver seu problema. Isso é semelhante ao novo recurso Copilot da Microsoft no Windows, que é baseado no modelo da OpenAI.

A OpenAI também reconhece os desafios do ChatGPT, como o problema contínuo de alucinação. Ao alinhar com o recurso de imagem, a marca decidiu limitar certas funcionalidades, como a “habilidade do chatbot de analisar e fazer declarações diretas sobre pessoas”.

O ChatGPT foi introduzido pela primeira vez como uma ferramenta de texto para fala no final do ano passado; no entanto, a OpenAI rapidamente expandiu suas capacidades. O chatbot original baseado no modelo de linguagem GPT-3 foi atualizado para GPT-3.5 e agora GPT-4, que é o modelo que está recebendo o novo recurso.

Quando o GPT-4 foi lançado em março, a OpenAI anunciou várias colaborações corporativas, como a do Duolingo, que utilizou o modelo de IA para melhorar a precisão das lições de escuta e fala no aplicativo de aprendizado de idiomas. A OpenAI colaborou com o Spotify na tradução de podcasts para outros idiomas, preservando o som da voz do apresentador. A empresa também mencionou seu trabalho com o aplicativo móvel Be My Eyes, que auxilia pessoas cegas e com baixa visão. Muitos desses aplicativos e serviços já estavam disponíveis antes da atualização de imagens e voz.