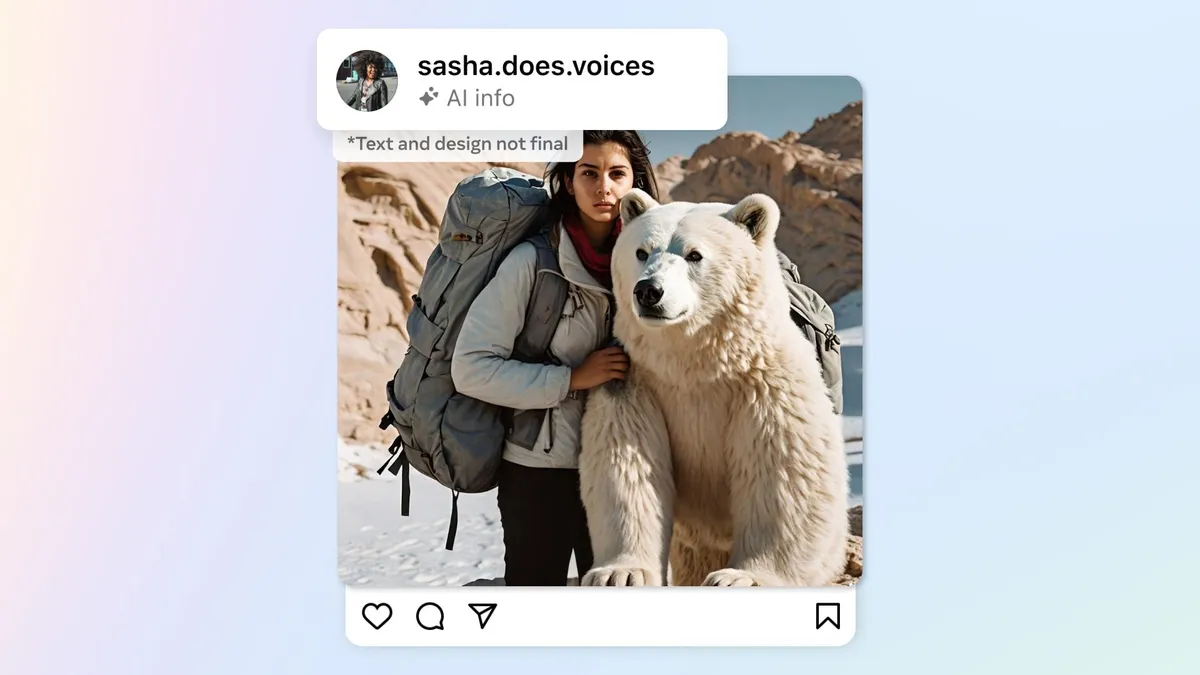

🖼️ Imagens geradas com DALL-E 3 e API da OpenAI agora possuem marca d’água! 🖼️

É um passo positivo, mas as marcas d'água não são infalíveis.

OpenAI agora irá incluir marcas d’água nas imagens geradas por ChatGPT usando DALL-E 3.

💦 Cansado de nadar em um mar de deepfakes e desinformação? A OpenAI está aqui para te ajudar! Em um anúncio recente, a empresa revelou que as imagens criadas usando suas poderosas ferramentas de IA, DALL-E 3 e a OpenAI API, agora virão com novas marcas d’água brilhantes. Vamos mergulhar e explorar o que isso significa para o mundo da mídia gerada por IA. 💦

📸 Certificando a Autenticidade com Metadados C2PA

A OpenAI está mostrando sua força tecnológica integrando metadados nas imagens geradas por ChatGPT e pela OpenAI API. Esses metadados, criados seguindo as especificações da Coalition for Content Provenance and Authenticity (C2PA), permitem aos usuários verificar a origem e o histórico do conteúdo da mídia. 🧐

O padrão C2PA, apoiado por grandes nomes como Adobe, Microsoft e BBC, tem como objetivo combater o aumento dos deepfakes e da desinformação. Ao certificar a autenticidade da mídia, ele serve como um escudo contra trapaças digitais. Com a OpenAI adotando este padrão, os usuários agora podem ter tranquilidade, sabendo que as imagens que encontram podem ser rastreadas até suas origens na IA. 🕵️♂️

🧩 O Enigma dos Metadados

Mas afinal, o que são esses metadados mágicos? Bem, eles incluem informações sobre a ferramenta de IA usada e a data em que a imagem foi gerada. 🗓️ Você até pode analisar os metadados fazendo o upload da imagem para sites de verificação, como Content Credentials. É como CSI: Edição Cibernética! 🔍

E fiquem tranquilos, caros leitores! A OpenAI nos assegura que esses metadados adicionais não afetarão a qualidade da imagem, apesar de um leve aumento no tamanho do arquivo. Portanto, você pode ter suas imagens de IA de alta qualidade e ainda receber a certificação como bônus. 🍰

- O gerador de imagens DALL-E 3, da OpenAI, adiciona marcas d’á...

- 📸 Captura e Descubra com a função de Perguntas e Respostas de Image...

- O Compromisso da Lenovo em Desmontar Viés de IA e Promover a Inclusão

👻 Cuidado com os Deepfakes!

As ferramentas de geração de imagens por IA se tornaram mais acessíveis do que nunca. Com DALL-E 3, Midjourney, Bard e Copilot, qualquer um pode criar seus próprios deepfakes ou espalhar informações enganosas mais rápido do que um guepardo de patins. É como dar um lançador de chamas para uma criança. 🔥

Recentemente, deepfakes escandalosos da Taylor Swift incendiaram a internet, destacando a necessidade urgente de verificação de imagens e proteções robustas, especialmente para figuras públicas. Na verdade, o Presidente Biden emitiu uma ordem executiva em outubro de 2023 exigindo a rotulagem de conteúdo gerado por IA. O Departamento de Comércio foi encarregado de fornecer orientações sobre marcas d’água, além de exigir que os criadores de bases de IA mantenham o governo informado sobre seus desenvolvimentos. 📜

❓ P&R: Mergulhando Mais Fundo no Abismo das Imagens Geradas por IA ❓

P: Os metadados não podem ser facilmente removidos, tornando as marcas d’água inúteis? R: Você está absolutamente certo! As plataformas de mídia social muitas vezes removem os metadados das imagens enviadas, e até mesmo uma boa captura de tela pode apagá-los. Portanto, embora as marcas d’água sejam um passo na direção certa, elas não são um escudo invencível. A luta contra os deepfakes continua, meu amigo.

P: E quanto a outras formas de conteúdo gerado por IA, como voz ou texto? Eles também são marcados com marcas d’água? R: Ótima pergunta! A festa das marcas d’água é exclusiva para imagens geradas por IA criadas pelo ChatGPT e pela OpenAI API. Então, infelizmente, vozes e textos não usarão marcas d’água fashionistas por enquanto. Vamos deixar isso para as imagens exibirem!

🌐 O Futuro da Verificação de Imagens por IA

A inclusão de marcas d’água em imagens geradas por IA pela OpenAI é um passo promissor na batalha contra a decepção digital. No entanto, é essencial continuar empurrando os limites da tecnologia. Melhorar os métodos de detecção de deepfakes, desenvolver sistemas robustos de rastreamento de metadados e aprimorar a autenticidade geral do conteúdo serão fundamentais na luta contínua por uma paisagem digital mais confiável. 🛡️

🔗 Referências: 1. Tweet da OpenAI sobre a Implementação das Marcas d’Água 2. Site da Coalition for Content Provenance and Authenticity (C2PA) 3. Bard Cria Imagem da Taylor Swift Apesar do Google Implicar o Contrário 4. Estudo do Wall Street Journal Destaca a Exposição dos Jovens a Conteúdo de Conflito no TikTok 5. Executivo de IA se Torna Defensor de Artistas 6. Google Lança SynthID, uma Marca Invisível em Imagens de IA 7. Novo Projeto de Lei no Senado para Lidar com Deepfakes de AI Não Consentidos 8. OpenAI Lança Atualização para Corrigir Vazamento de Dados do ChatGPT 9. OpenAI Toma Medidas para Reduzir Riscos Regulatórios com a Privacidade de Dados da UE

Vamos tornar o mundo digital um lugar mais seguro juntos! 🌐 Compartilhe este artigo e espalhe a palavra sobre a importância da verificação de imagens de IA. 💙✨