🤖 Falhas do ChatGPT Expostas Vazamento de Dados e Problemas de Segurança Ainda Persistem 🚨

A falha de segurança no ChatGPT pode comprometer suas conversas e informações pessoais.

OpenAI lançou um patch para tratar o vazamento de dados no ChatGPT, mas o problema ainda não está totalmente resolvido.

Já dissemos antes, e vamos dizer novamente: Não insira nada no ChatGPT que você não queira que partes não autorizadas leiam. Desde que a OpenAI lançou o ChatGPT no ano passado, houve várias instâncias em que falhas no chatbot de IA poderiam ter sido usadas para acessar dados sensíveis ou privados. E aqui estamos novamente, com um exemplo recente mostrando que mesmo após uma correção de segurança, os problemas ainda podem persistir.

De acordo com um relatório do Bleeping Computer, a OpenAI lançou uma correção para um problema em que o ChatGPT poderia vazar os dados dos usuários para terceiros não autorizados. Isso inclui as conversas do usuário com o ChatGPT e metadados correspondentes, como ID do usuário e informações de sessão.

No entanto, o pesquisador de segurança Johann Rehberger, que descobriu originalmente a vulnerabilidade e explicou como ela funcionava, afirma que ainda existem falhas graves de segurança na correção da OpenAI. Em outras palavras, a falha de segurança ainda está muito presente.

Vazamento de Dados do ChatGPT 💧

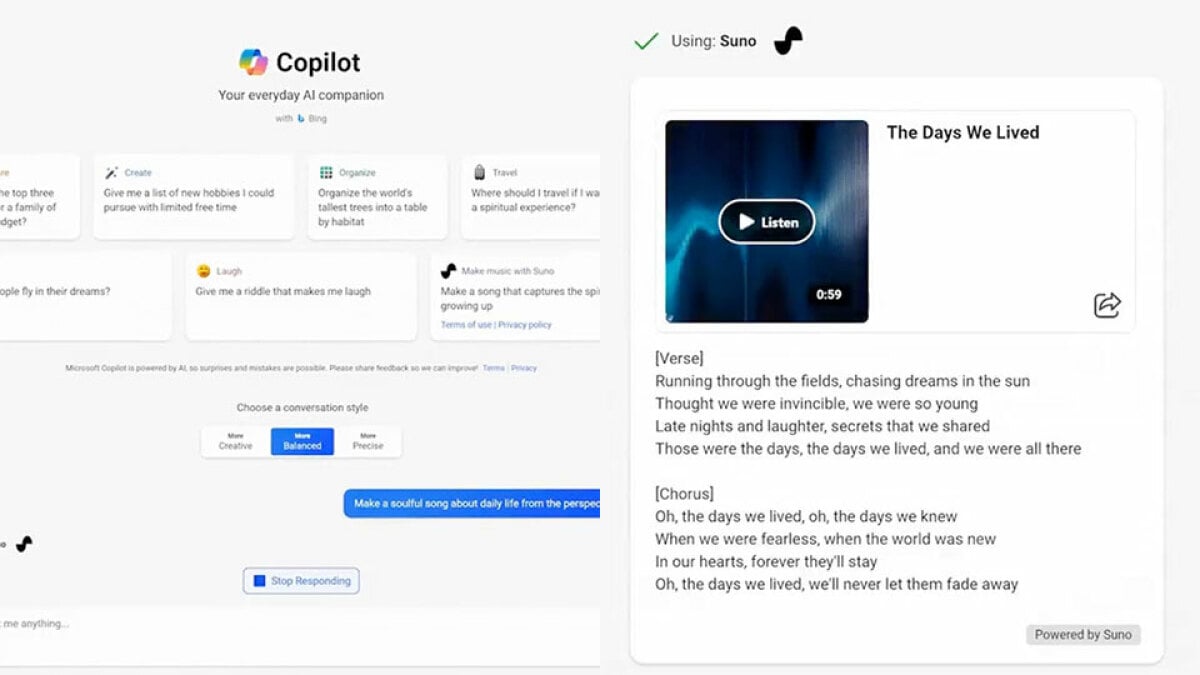

Rehberger aproveitou o recurso de GPTs personalizados recentemente lançado e altamente aclamado pela OpenAI para criar o próprio GPT dele, que conseguiu extrair dados do ChatGPT. Essa descoberta é significativa porque os GPTs personalizados estão sendo comercializados como aplicativos de IA semelhantes à forma como o iPhone revolucionou os aplicativos móveis com a App Store. Se Rehberger foi capaz de criar esse GPT personalizado, sugere que agentes mal-intencionados poderiam em breve explorar a falha e criar GPTs personalizados para roubar dados de alvos desprevenidos.

Rehberger entrou em contato inicialmente com a OpenAI sobre a “técnica de exfiltração de dados” em abril. Em seguida, em novembro, ele entrou novamente em contato para explicar como foi capaz de criar um GPT personalizado e realizar o processo.

- 🚀 Desvendando o Poder do DALL-E 3 no ChatGPT Plus Uma Jornada de Mo...

- Projeto de Superalinhamento da OpenAI Domando os AIs Superinteligen...

- 🤖 Plano de Biden para Inteligência Artificial enfrenta desafios orç...

Na quarta-feira, Rehberger publicou uma atualização em seu site, revelando que a OpenAI havia corrigido a vulnerabilidade de vazamento. No entanto, ele também observou que a correção não é perfeita, pois o ChatGPT ainda está vazando dados por meio da vulnerabilidade que ele descobriu. O ChatGPT ainda pode ser enganado para enviar dados, embora em pequenas quantidades e em um ritmo mais lento, tornando-o mais perceptível para os usuários. Apesar dos problemas restantes, Rehberger reconheceu que é definitivamente um “passo na direção certa”.

Infelizmente, a falha de segurança ainda afeta os aplicativos ChatGPT para iOS e Android, que ainda não receberam uma atualização para corrigir o problema. Portanto, se você é usuário do ChatGPT, é altamente recomendável que você seja cauteloso e evite GPTs personalizados de terceiros desconhecidos.

🔍 Preocupações de Segurança e Perguntas e Respostas

P: Posso confiar no ChatGPT com minhas conversas privadas? R: Embora a OpenAI tenha lançado uma correção de segurança, ainda existem vulnerabilidades persistentes que podem expor suas conversas a terceiros não autorizados. É aconselhável evitar discutir informações confidenciais ou sensíveis na plataforma.

P: Qual é o impacto potencial de vazamentos de dados do ChatGPT? R: Vazamentos de dados podem levar a várias consequências, como roubo de identidade, violações de privacidade e acesso não autorizado a informações pessoais ou sensíveis. É crucial ser cauteloso e estar ciente dos riscos ao usar chatbots de IA como o ChatGPT.

P: Existem alternativas ao ChatGPT que ofereçam melhor segurança? R: Existem plataformas alternativas de chatbot de IA disponíveis que priorizam a segurança e a privacidade. Antes de usar qualquer chatbot de IA, é essencial pesquisar e escolher uma plataforma confiável e confiável que priorize a proteção de dados.

💡 Desenvolvimentos Futuros e Impacto

A descoberta dessas falhas no ChatGPT destaca os desafios contínuos em garantir a segurança dos chatbots de IA. À medida que a tecnologia de IA continua a avançar, é crucial que desenvolvedores e pesquisadores priorizem medidas robustas de segurança. Além disso, a conscientização dos usuários em relação aos riscos potenciais e a adoção de precauções de privacidade desempenharão um papel importante na redução de vulnerabilidades e na possibilitação de interações mais seguras com chatbots de IA.

A resposta da OpenAI a esse incidente, sem dúvida, moldará o desenvolvimento futuro do ChatGPT e seus aplicativos associados. Auditorias regulares de segurança, correções rápidas de bugs e vigilância constante serão essenciais para construir a confiança do usuário e garantir a proteção de dados sensíveis.

🔗 Referências: – Bleeping Computer – GPTs Personalizados – Aplicativos de IA – Inteligência Artificial – Cibersegurança – ChatGPT – OpenAI

Lembrando, galera, sempre fiquem cautelosos ao lidar com chatbots de IA e não compartilhem segredos que possam voltar para assombrar vocês! Compartilhem este artigo e espalhem a palavra sobre a importância da segurança de dados na era da IA. 💻🛡️💪